|

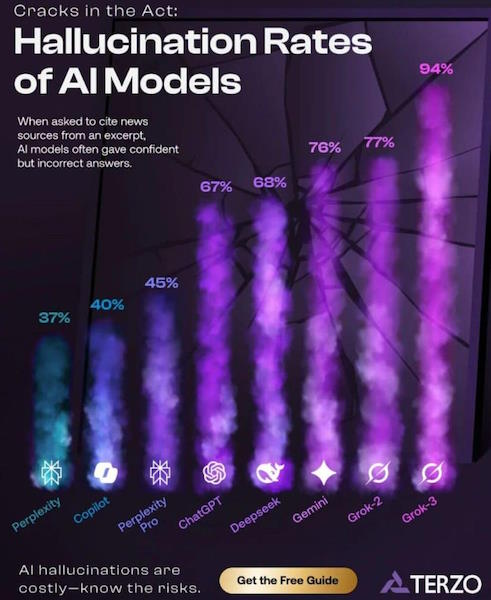

Частота галлюцинаций у популярных моделей ИИ

|

| «Галлюцинацией» называют ситуации, когда большая языковая модель утверждает нечто как факт, хотя информация ложна или не имеет оснований. Причина проста: стандартные методы обучения поощряют догадки, а не признание неопределенности. Представьте экзамен с вариантами ответов: угадав, вы с большей вероятностью получите балл, чем оставив вопрос пустым. С ИИ происходит то же самое. |

| Инфографика выше, основанная на последнем исследовании от Terzo, демонстрирует, как часто различные модели ИИ выдают ошибки. Чтобы оценить склонность к «галлюцинациям», исследователи предложили моделям от ведущих компаний фрагменты новостных текстов. Задача была одна — определить оригинальную статью, издание и URL. |

|

| Эксперимент поставили таким образом, что обычный поиск Google по этим фрагментам возвращал исходный материал в числе первых трех результатов. Затем ответы моделей проверяли на точность. Согласно данным тестов Grok-3 показал худший результат — «галлюцинировал» в 94% случаев. Perplexity, напротив, продемонстрировал наибольшую точность. Любопытно, что платные версии моделей справились хуже, чем их бесплатные аналоги. И почти все модели не выражали сомнений, даже когда ошибались. |

| Источник |